Traducción automática

La función de traducción IA le permite generar automáticamente traducciones para el archivo TS abierto utilizando grandes modelos lingüísticos (LLM). Puede utilizar un servidor LLM local (como Ollama, LM Studio o llama.cpp) o API basadas en la nube que admitan el protocolo REST compatible con OpenAI (como OpenAI, Groq o Anthropic).

Qt Linguist admite dos modos de API:

- Ollama - API REST nativa de Ollama. Utilícela cuando ejecute Ollama localmente.

- Compatible con OpenAI - El formato estándar de la API REST de OpenAI. Utilícelo para:

- Servidores locales: LM Studio, llama.cpp u Ollama (que también admite el modo compatible con OpenAI).

- Proveedores en la nube: OpenAI, Groq, DeepSeek, y otros

Configuración de un servidor LLM local

Para utilizar AI Translation con un servidor local, instala uno de los siguientes y descarga al menos un modelo:

- Ollama - Fácil de usar, gestiona los modelos automáticamente

- LM Studio - Aplicación GUI con navegador de modelos

- llama.cpp - Ligero, ejecuta modelos GGUF directamente

Nota: La ejecución local de los LLM requiere memoria suficiente en función del tamaño del modelo y del nivel de cuantificación. Consulte la documentación de su servidor LLM para conocer los requisitos específicos, por ejemplo, los requisitos del sistema de LM Studio.

Para Ollama, extraiga un modelo utilizando la línea de comandos:

ollama pull qwen3:14b

ollama servePara LM Studio, descargue modelos a través de la interfaz de la aplicación e inicie el servidor local:

lms server start

Para llama.cpp, puede utilizar uno de los modelos preestablecidos incorporados:

llama-server --fim-qwen-7b-default

O descargar un archivo de modelo GGUF e iniciar el servidor manualmente:

llama-server -m model.gguf --port 8080

Uso de las API de la nube

Para utilizar servicios de traducción basados en la nube, seleccione OpenAI Compatible como tipo de API, introduzca la URL del punto final de la API del proveedor y proporcione su clave de API.

Introduzca sólo la URL base sin el sufijo de ruta /v1. Por ejemplo, para OpenRouter utilice https://openrouter.ai/api. Consulte la documentación de su proveedor para conocer la URL de punto final correcta.

Uso del cuadro de diálogo de traducción de AI

En Linguist, seleccione Tools > AI Translation para abrir el cuadro de diálogo AI Translation:

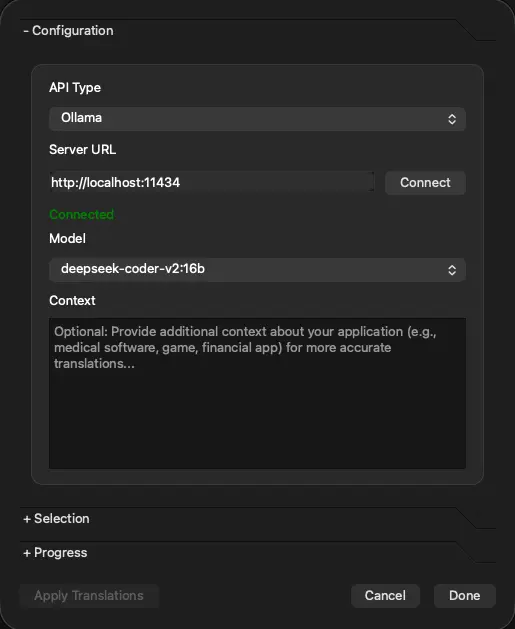

La parte Configuration del diálogo proporciona:

- API Type: elija Ollama para servidores locales de Ollama que utilicen la API nativa de Ollama, u OpenAI Compatible para LM Studio, llama.cpp, APIs en la nube, u Ollama en modo compatible con OpenAI.

- Server URL: la URL base donde escucha el servidor. No incluya el sufijo de ruta

/v1. Por defecto:http://localhost:11434para Ollama,http://localhost:8080para OpenAI Compatible. - API Key: clave de autenticación para APIs en la nube (opcional para servidores locales).

- Model: lista desplegable de modelos disponibles.

- Context: contexto de aplicación opcional para mejorar la precisión de la traducción (por ejemplo, "software médico", "videojuego", "aplicación financiera").

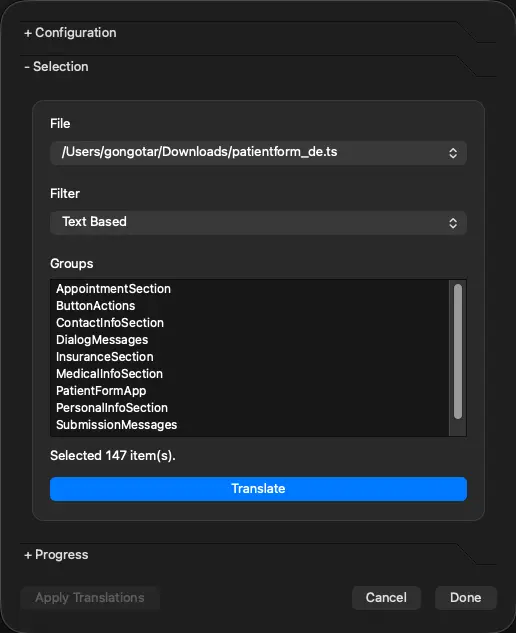

La parte Selection del diálogo proporciona:

- File: el archivo TS a traducir.

- Filter: limitar la traducción a grupos específicos (contextos o etiquetas).

- Translate: iniciar la traducción de la IA.

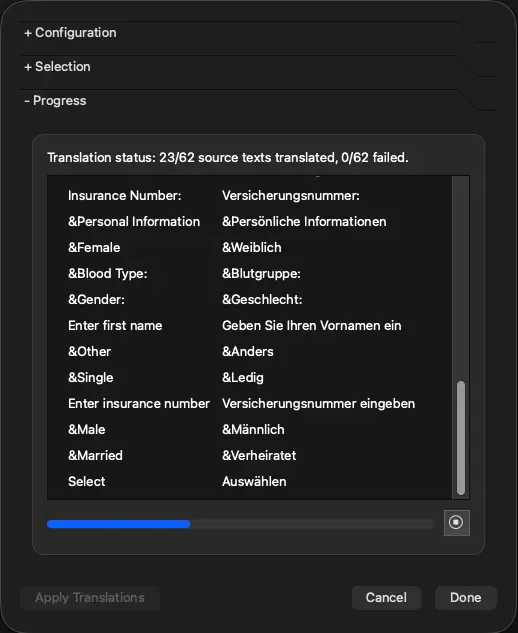

La parte Progress del diálogo proporciona:

- Un botón de parada para detener el progreso de la traducción

- Apply Translations: aplicar los elementos traducidos en el archivo TS.

Durante la traducción, aparecen mensajes de progreso en Translation Log. Una vez finalizada, revisa los textos traducidos en el registro. Haz clic en Apply Translations para insertar las traducciones generadas por la IA en el archivo TS.

Modelos recomendados

Se recomiendan los siguientes modelos para las tareas de traducción, equilibrando calidad, velocidad y uso de recursos. Estos modelos se pueden encontrar en:

- Ollama - búsqueda por nombre de modelo (por ejemplo,

ollama pull qwen3:14b) - LM Studio - búsqueda en el navegador de modelos

- Hugging Face - descarga archivos GGUF para llama.cpp

| Modelo | Tamaño | Notas |

|---|---|---|

| Mistral Pequeño 24B | 14 GB | Alta calidad de traducción con gran compatibilidad multilingüe. Requiere >16 GB de VRAM para un rendimiento óptimo. |

| Qwen3 14B | 9 GB | Equilibrio entre calidad y uso de recursos. Soporta más de 100 idiomas. |

| Qwen3 30B | 19 GB | Traducciones de alta calidad. Utiliza la arquitectura MoE para una inferencia eficiente. |

| Qwen2.5 14 GB | 9 GB | Sólido soporte multilingüe para más de 29 idiomas, incluidos los idiomas CJK. |

| Gemma 3 12B | 8 GB | Soporta más de 140 idiomas. Adecuado para sistemas con recursos limitados. |

| 7shi/llama-translate 8B | 5 GB | Modelo de traducción especializado para inglés, francés, chino y japonés. Opción ligera para hardware limitado. Disponible sólo en Ollama. |

Para sistemas con recursos limitados, las variantes más pequeñas como Qwen3 8B (5 GB) o Qwen2.5 7B (5 GB) proporcionan una calidad de traducción razonable a la vez que requieren menos memoria.

Nota: La calidad de la traducción varía según el par de idiomas y el modelo. Pruebe diferentes modelos para encontrar la mejor combinación de velocidad, calidad y uso de recursos para sus necesidades específicas de traducción.

© 2026 The Qt Company Ltd. Documentation contributions included herein are the copyrights of their respective owners. The documentation provided herein is licensed under the terms of the GNU Free Documentation License version 1.3 as published by the Free Software Foundation. Qt and respective logos are trademarks of The Qt Company Ltd. in Finland and/or other countries worldwide. All other trademarks are property of their respective owners.