AI 번역

AI 번역 기능을 사용하면 대규모 언어 모델(LLM)을 사용하여 열린 TS 파일에 대한 번역을 자동으로 생성할 수 있습니다. 로컬 LLM 서버(예: Ollama, LM Studio 또는 llama.cpp) 또는 OpenAI 호환 REST 프로토콜을 지원하는 클라우드 기반 API(예: OpenAI, Groq 또는 Anthropic)를 사용할 수 있습니다.

Qt Linguist 두 가지 API 모드를 지원합니다:

- Ollama - Ollama의 기본 REST API. Ollama를 로컬에서 실행할 때 사용합니다.

- OpenAI 호환 - 표준 OpenAI REST API 형식입니다. 다음 용도로 사용합니다:

- 로컬 서버: LM Studio, llama.cpp 또는 Ollama(OpenAI 호환 모드도 지원)

- 클라우드 제공업체: OpenAI, Groq, DeepSeek 등

로컬 LLM 서버 설정

로컬 서버에서 AI 번역을 사용하려면 다음 중 하나를 설치하고 하나 이상의 모델을 다운로드하세요:

참고: 로컬에서 LLM을 실행하려면 모델 크기와 양자화 수준에 따라 충분한 메모리가 필요합니다. 구체적인 요구 사항(예: LM Studio 시스템 요구 사항)은 해당 LLM 서버의 설명서를 참조하세요.

Ollama의 경우 명령줄을 사용하여 모델을 가져옵니다:

ollama pull qwen3:14b

ollama serveLM Studio의 경우 애플리케이션의 인터페이스를 통해 모델을 다운로드하고 로컬 서버를 시작합니다:

lms server start

llama.cpp의 경우 기본 제공 모델 프리셋 중 하나를 사용할 수 있습니다:

llama-server --fim-qwen-7b-default

또는 GGUF 모델 파일을 다운로드하고 서버를 수동으로 시작하세요:

llama-server -m model.gguf --port 8080

클라우드 API 사용

클라우드 기반 번역 서비스를 사용하려면 API 유형으로 OpenAI 호환을 선택하고 제공업체의 API 엔드포인트 URL을 입력한 다음 API 키를 제공하세요.

/v1 경로 접미사 없이 기본 URL만 입력하세요. 예를 들어 OpenRouter의 경우 https://openrouter.ai/api 을 사용합니다. 올바른 엔드포인트 URL은 제공업체의 설명서를 참조하세요.

AI 번역 대화 상자 사용하기

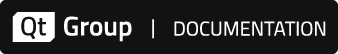

언어 전문가에서 Tools > AI Translation 을 선택하여 AI 번역 대화 상자를 엽니다:

대화 상자의 Configuration 부분이 제공됩니다:

- API Type오라마의 기본 API를 사용하는 로컬 오라마 서버의 경우 오라마를 선택하거나 LM Studio용 OpenAI 호환, llama.cpp, 클라우드 API 또는 OpenAI 호환 모드의 오라마를 선택합니다.

- Server URL서버가 수신 대기하는 기본 URL입니다.

/v1경로 접미사를 포함하지 마십시오. 기본값: Ollama의 경우http://localhost:11434, OpenAI 호환의 경우http://localhost:8080. - API Key클라우드 API용 인증 키(로컬 서버의 경우 선택 사항).

- Model: 사용 가능한 모델의 드롭다운 목록.

- Context: 번역 정확도를 높이기 위한 선택적 애플리케이션 컨텍스트(예: "의료 소프트웨어", "비디오 게임", "금융 애플리케이션").

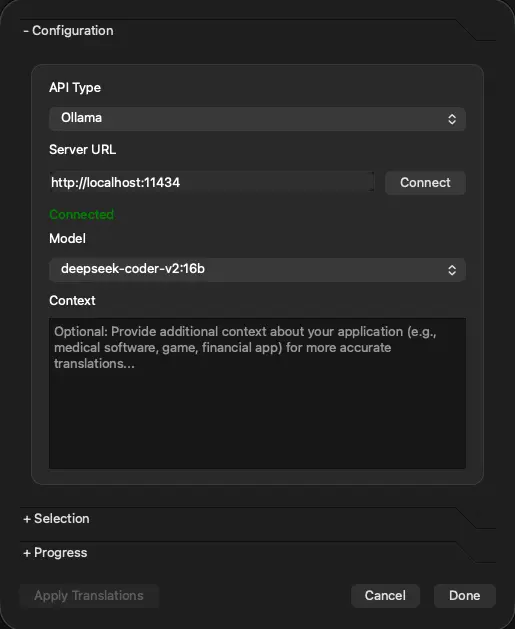

대화 상자의 Selection 부분이 제공합니다:

- File번역할 TS 파일.

- Filter번역을 특정 그룹(컨텍스트 또는 레이블)으로 제한합니다.

- Translate를 클릭하여 AI 번역을 시작합니다.

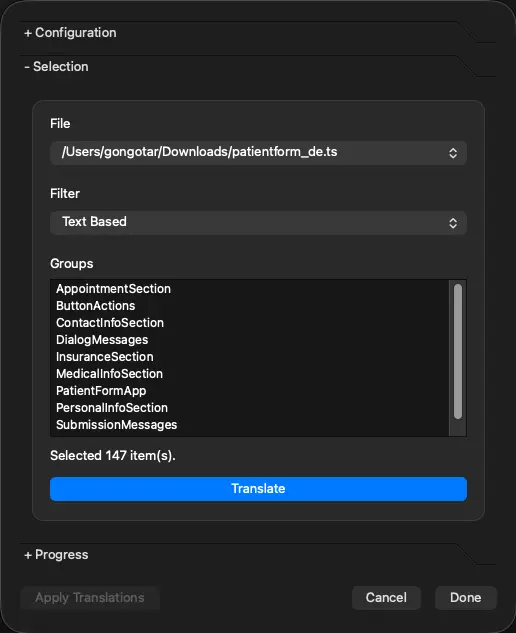

대화 상자의 Progress 부분은 다음을 제공합니다:

- 번역 진행을 중지하는 중지 버튼

- Apply Translations번역된 항목을 TS 파일에 적용합니다.

번역 중에는 진행률 메시지가 Translation Log 에 표시됩니다. 번역이 완료되면 로그에서 번역된 텍스트를 검토합니다. Apply Translations 을 클릭하여 AI가 생성한 번역을 TS 파일에 삽입합니다.

추천 모델

번역 작업에는 품질, 속도 및 리소스 사용량 간의 균형을 맞추기 위해 다음 모델을 권장합니다. 이러한 모델은 다음에서 찾을 수 있습니다:

- Ollama - 모델명으로 검색(예:

ollama pull qwen3:14b) - LM Studio - 모델 브라우저에서 검색

- Hugging Face - llama.cpp용 GGUF 파일 다운로드

| 모델 | 크기 | 참고 |

|---|---|---|

| 미스트랄 스몰 24B | 14GB | 강력한 다국어 지원으로 높은 번역 품질을 제공합니다. 최적의 성능을 위해 16GB 이상의 VRAM이 필요합니다. |

| Qwen3 14B | 9 GB | 품질과 리소스 사용량의 균형. 100개 이상의 언어를 지원합니다. |

| Qwen3 30B | 19 GB | 고품질 번역. 효율적인 추론을 위해 MoE 아키텍처를 사용합니다. |

| Qwen2.5 14B | 9 GB | 한중일 언어를 포함한 29개 이상의 언어에 대한 강력한 다국어 지원. |

| Gemma 3 12B | 8 GB | 140개 이상의 언어를 지원합니다. 리소스가 제한된 시스템에 적합합니다. |

| 7shi/llama-translate 8B | 5 GB | 영어, 프랑스어, 중국어, 일본어에 특화된 번역 모델입니다. 제한된 하드웨어를 위한 경량 옵션. 올라마에서만 사용 가능. |

리소스가 제한된 시스템의 경우 Qwen3 8B(5GB) 또는 Qwen2.5 7B(5GB)와 같은 더 작은 버전이 더 적은 메모리를 필요로 하면서도 합리적인 번역 품질을 제공합니다.

참고: 번역 품질은 언어 쌍과 모델에 따라 다릅니다. 다양한 모델을 테스트하여 특정 번역 요구 사항에 가장 적합한 속도, 품질 및 리소스 사용량 조합을 찾아보세요.

© 2026 The Qt Company Ltd. Documentation contributions included herein are the copyrights of their respective owners. The documentation provided herein is licensed under the terms of the GNU Free Documentation License version 1.3 as published by the Free Software Foundation. Qt and respective logos are trademarks of The Qt Company Ltd. in Finland and/or other countries worldwide. All other trademarks are property of their respective owners.