AI-Übersetzung

Mit der KI-Übersetzungsfunktion können Sie automatisch Übersetzungen für die geöffnete TS-Datei mithilfe von großen Sprachmodellen (LLMs) generieren. Sie können entweder einen lokalen LLM-Server (wie Ollama, LM Studio oder llama.cpp) oder Cloud-basierte APIs verwenden, die das OpenAI-kompatible REST-Protokoll unterstützen (wie OpenAI, Groq oder Anthropic).

Qt Linguist unterstützt zwei API-Modi:

- Ollama - Ollamas native REST-API. Verwenden Sie dies, wenn Sie Ollama lokal ausführen.

- OpenAI-kompatibel - Das standardmäßige OpenAI-REST-API-Format. Verwenden Sie dies für:

- Lokale Server: LM Studio, llama.cpp, oder Ollama (das auch den OpenAI-kompatiblen Modus unterstützt)

- Cloud-Anbieter: OpenAI, Groq, DeepSeek, und andere

Einrichten eines lokalen LLM-Servers

Um AI Translation mit einem lokalen Server zu verwenden, installieren Sie eines der folgenden Programme und laden Sie mindestens ein Modell herunter:

- Ollama - Einfach zu benutzen, verwaltet Modelle automatisch

- LM Studio - GUI-Anwendung mit Modell-Browser

- llama.cpp - Leichtgewichtig, führt GGUF-Modelle direkt aus

Hinweis: Die lokale Ausführung von LLMs erfordert je nach Modellgröße und Quantisierungsgrad ausreichend Speicherplatz. Spezifische Anforderungen finden Sie in der Dokumentation Ihres LLM-Servers, zum Beispiel LM Studio System Requirements.

Für Ollama ziehen Sie ein Modell über die Kommandozeile:

ollama pull qwen3:14b

ollama serveBei LM Studio laden Sie Modelle über die Schnittstelle der Anwendung herunter und starten den lokalen Server:

lms server start

Für llama.cpp können Sie entweder eine der integrierten Modellvoreinstellungen verwenden:

llama-server --fim-qwen-7b-default

Oder Sie laden eine GGUF-Modelldatei herunter und starten den Server manuell:

llama-server -m model.gguf --port 8080

Cloud-APIs verwenden

Um Cloud-basierte Übersetzungsdienste zu verwenden, wählen Sie OpenAI Compatible als API-Typ, geben Sie die API-Endpunkt-URL des Anbieters ein und geben Sie Ihren API-Schlüssel an.

Geben Sie nur die Basis-URL ohne das Pfad-Suffix /v1 ein. Verwenden Sie zum Beispiel für OpenRouter https://openrouter.ai/api. Die richtige Endpunkt-URL finden Sie in der Dokumentation Ihres Anbieters.

Verwendung des AI-Übersetzungsdialogs

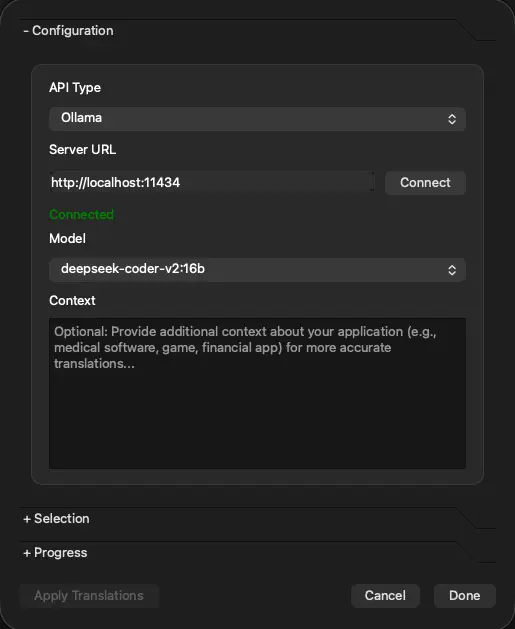

Wählen Sie in Linguist Tools > AI Translation, um den AI-Übersetzungsdialog zu öffnen:

Der Configuration Teil des Dialogs bietet:

- API Type: wählen Sie Ollama für lokale Ollama-Server, die die native API von Ollama verwenden, oder OpenAI-kompatibel für LM Studio, llama.cpp, Cloud-APIs oder Ollama im OpenAI-kompatiblen Modus.

- Server URL: die Basis-URL, an der der Server lauscht. Fügen Sie das Pfad-Suffix

/v1nicht ein. Standard:http://localhost:11434für Ollama,http://localhost:8080für OpenAI-kompatibel. - API KeyAuthentifizierungsschlüssel: Authentifizierungsschlüssel für Cloud-APIs (optional für lokale Server).

- ModelDropdown-Liste der verfügbaren Modelle.

- Context: optionaler Anwendungskontext zur Verbesserung der Übersetzungsgenauigkeit (z. B. "medizinische Software", "Videospiel", "Finanzanwendung").

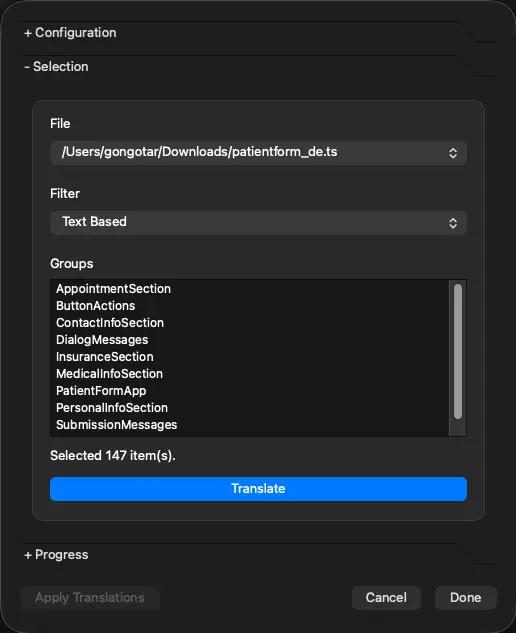

Der Selection Teil des Dialogs bietet:

- File: die zu übersetzende TS-Datei.

- Filter: Begrenzung der Übersetzung auf bestimmte Gruppen (Kontexte oder Labels).

- Translate: die AI-Übersetzung starten.

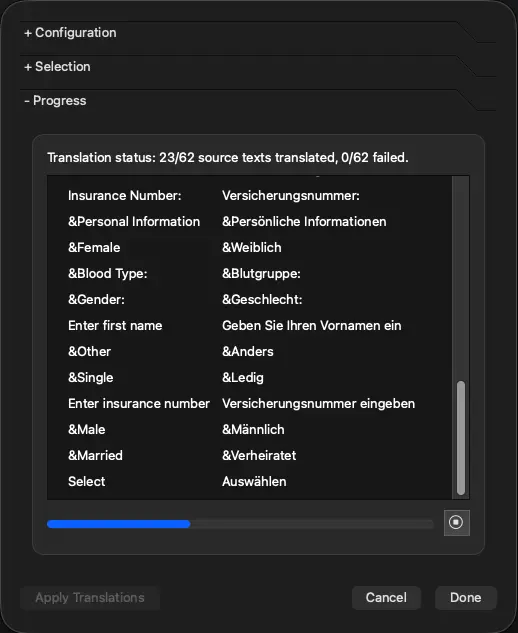

Der Progress Teil des Dialogs bietet:

- eine Stopp-Schaltfläche, um den Übersetzungsprozess zu stoppen

- Apply Translations: Übernahme der übersetzten Elemente in die TS-Datei.

Während der Übersetzung werden auf Translation Log Fortschrittsmeldungen angezeigt. Nach Abschluss der Übersetzung können Sie die übersetzten Texte im Protokoll einsehen. Klicken Sie auf Apply Translations, um die von AI erstellten Übersetzungen in die TS-Datei einzufügen.

Empfohlene Modelle

Die folgenden Modelle werden für Übersetzungsaufgaben empfohlen, um ein Gleichgewicht zwischen Qualität, Geschwindigkeit und Ressourcenverbrauch herzustellen. Diese Modelle finden Sie auf:

- Ollama - Suche nach dem Modellnamen (z. B.

ollama pull qwen3:14b) - LM Studio - Suche im Modellbrowser

- Hugging Face - GGUF-Dateien für llama.cpp herunterladen

| Modell | Größe | Anmerkungen |

|---|---|---|

| Mistral Klein 24B | 14 GB | Hohe Übersetzungsqualität mit starker mehrsprachiger Unterstützung. Erfordert >16 GB VRAM für optimale Leistung. |

| Qwen3 14B | 9 GB | Ausgewogenes Verhältnis zwischen Qualität und Ressourcenverbrauch. Unterstützt über 100 Sprachen. |

| Qwen3 30B | 19 GB | Hochwertige Übersetzungen. Verwendet MoE-Architektur für effiziente Inferenz. |

| Qwen2.5 14B | 9 GB | Starke mehrsprachige Unterstützung für mehr als 29 Sprachen, einschließlich CJK-Sprachen. |

| Gemma 3 12B | 8 GB | Unterstützt über 140 Sprachen. Gut für ressourcenbeschränkte Systeme. |

| 7shi/llama-translate 8B | 5 GB | Spezialisiertes Übersetzungsmodell für Englisch, Französisch, Chinesisch und Japanisch. Leichte Option für begrenzte Hardware. Nur auf Ollama verfügbar. |

Für Systeme mit begrenzten Ressourcen bieten kleinere Varianten wie Qwen3 8B (5 GB) oder Qwen2.5 7B (5 GB) eine angemessene Übersetzungsqualität bei geringerem Speicherbedarf.

Hinweis: Die Übersetzungsqualität variiert je nach Sprachpaar und Modell. Testen Sie verschiedene Modelle, um die beste Kombination aus Geschwindigkeit, Qualität und Ressourcenverbrauch für Ihre speziellen Übersetzungsanforderungen zu finden.

© 2026 The Qt Company Ltd. Documentation contributions included herein are the copyrights of their respective owners. The documentation provided herein is licensed under the terms of the GNU Free Documentation License version 1.3 as published by the Free Software Foundation. Qt and respective logos are trademarks of The Qt Company Ltd. in Finland and/or other countries worldwide. All other trademarks are property of their respective owners.