AI翻訳

AI翻訳機能では、大規模言語モデル(LLM)を使用して、開いているTSファイルの翻訳を自動的に生成することができます。ローカルのLLMサーバー(Ollama、LM Studio、llama.cppなど)、またはOpenAI互換のRESTプロトコルをサポートするクラウドベースのAPI(OpenAI、Groq、Anthropicなど)のいずれかを使用できます。

Qt Linguist は2つのAPIモードをサポートしています:

- Ollama- Ollama のネイティブ REST API。Ollamaをローカルで実行する場合に使用します。

- OpenAI Compatible- 標準の OpenAI REST API フォーマットです。以下の場合に使用します:

- ローカルサーバ:LM Studio、llama.cpp、または Ollama (OpenAI 互換モードもサポート)

- クラウドプロバイダOpenAI、Groq、DeepSeek、その他

ローカルLLMサーバーのセットアップ

AI翻訳をローカルサーバーで使用するには、以下のいずれかをインストールし、少なくとも1つのモデルをダウンロードしてください:

注: ローカルでLLMを実行するには、モデルのサイズと量子化レベルに応じて十分なメモリが必要です。具体的な要件については、LLM サーバーのドキュメント(LM Studio のシステム要件など)を参照してください。

Ollamaの場合は、コマンドラインを使用してモデルをプルします:

ollama pull qwen3:14b

ollama serveLM Studio の場合は、アプリケーションのインターフェイスからモデルをダウンロードし、ローカルサーバを起動します:

lms server start

llama.cppについては、内蔵のモデルプリセットのいずれかを使用することができます:

llama-server --fim-qwen-7b-default

もしくは、GGUFモデルファイルをダウンロードし、手動でサーバーを起動してください:

llama-server -m model.gguf --port 8080

クラウドAPIの使用

クラウドベースの翻訳サービスを使用するには、APIタイプとしてOpenAI Compatibleを選択し、プロバイダのAPIエンドポイントURLを入力し、APIキーを入力します。

/v1 パスの接尾辞を除いたベース URL だけを入力してください。例えば、OpenRouter の場合はhttps://openrouter.ai/api を使用します。正しいエンドポイント URL については、プロバイダのドキュメントを参照してください。

AI翻訳ダイアログの使用

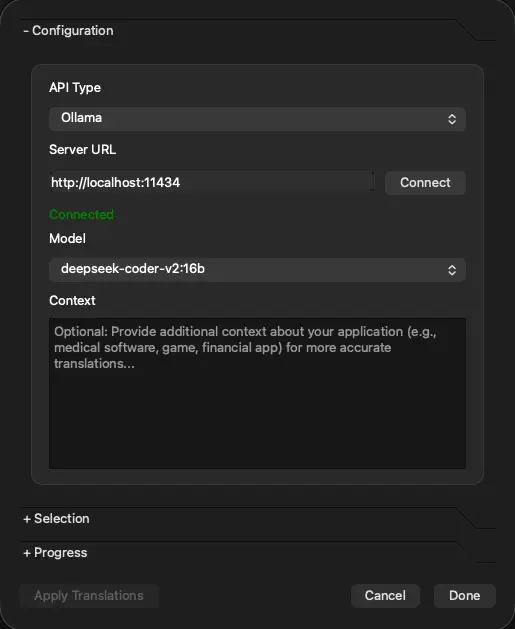

Linguistで、Tools > AI Translation を選択して、AI翻訳ダイアログを開きます:

ダイアログのConfiguration :

- API TypeOllamaのネイティブAPIを使ったローカルのOllamaサーバにはOllamaを、LM Studio、llama.cpp、クラウドAPI、OpenAI互換モードのOllamaにはOpenAI互換を選択します。

- Server URLサーバがリッスンするベース URL を指定します。

/v1のパスサフィックスを含めないでください。デフォルト: Ollamaの場合はhttp://localhost:11434、OpenAI互換の場合はhttp://localhost:8080。 - API KeyクラウドAPI用の認証キー(ローカルサーバーではオプション)。

- Model利用可能なモデルのドロップダウンリスト。

- Context翻訳精度を向上させるためのアプリケーションコンテキスト("医療ソフトウェア"、"ビデオゲーム"、"金融アプリケーション "など)。

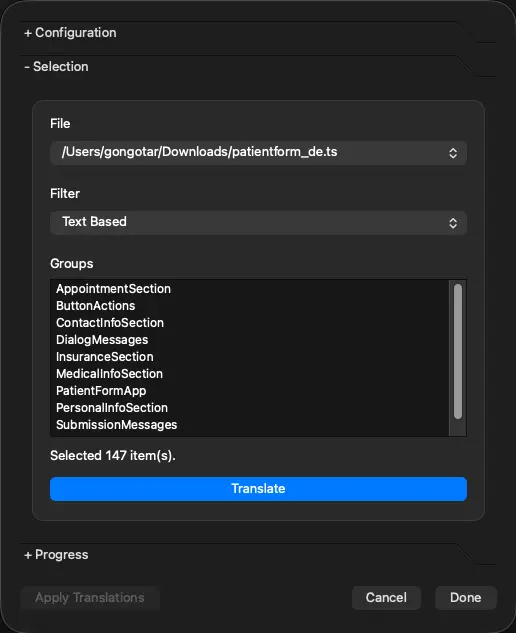

ダイアログのSelection :

- File翻訳するTSファイル。

- Filter特定のグループ(コンテキストまたはラベル)に翻訳を制限します。

- TranslateAI翻訳を開始します。

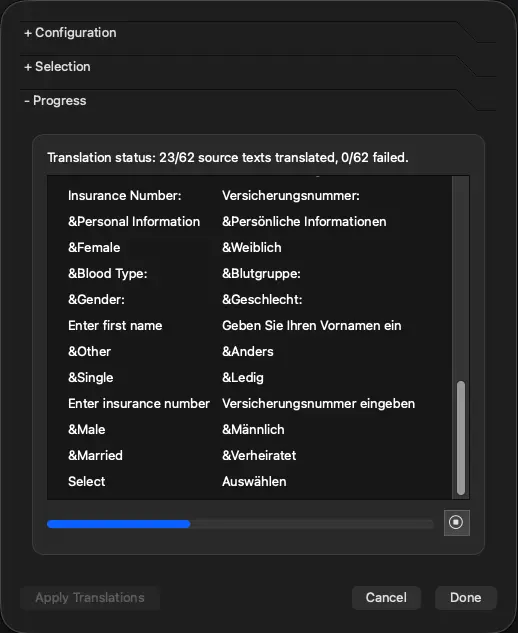

ダイアログのProgress :

- 翻訳の進行を停止する停止ボタン

- Apply Translations翻訳された項目をTSファイルに適用します。

翻訳中は、Translation Log に進行状況のメッセージが表示されます。 翻訳が完了したら、ログで翻訳されたテキストを確認します。Apply Translations をクリックすると、AIが作成した翻訳がTSファイルに挿入されます。

推奨モデル

翻訳タスクには、品質、スピード、リソース使用量のバランスを考慮して、以下のモデルを推奨します。これらのモデルは

- Ollama- モデル名で検索 (例:

ollama pull qwen3:14b) - LM Studio- モデルブラウザで検索

- Hugging Face- llama.cpp用のGGUFファイルをダウンロードする。

| モデル | サイズ | 備考 |

|---|---|---|

| ミストラル・スモール24B | 14 GB | 高い翻訳品質と強力な多言語サポート。最適なパフォーマンスを得るには16GB以上のVRAMが必要です。 |

| Qwen3 14B | 9 GB | 品質とリソース使用量のバランス。100以上の言語をサポート。 |

| Qwen3 30B | 19 GB | 高品質の翻訳。効率的な推論のために MoE アーキテクチャを使用。 |

| Qwen2.5 14B | 9 GB | 日中韓言語を含む29以上の言語を強力にサポート。 |

| Gemma3 12B | 8 GB | 140以上の言語をサポート。リソースに制約のあるシステムに最適。 |

| 7shi/llama-translate 8B | 5 GB | 英語、フランス語、中国語、日本語に特化した翻訳モデル。限られたハードウェア向けの軽量オプション。Ollama でのみ利用可能。 |

リソースが限られたシステムでは、Qwen3 8B (5 GB) や Qwen2.5 7B (5 GB) のような小型の翻訳モデルが、より少ないメモリで適切な翻訳品質を提供します。

注: 翻訳品質は言語ペアやモデルによって異なります。さまざまなモデルをテストして、特定の翻訳ニーズに最適な速度、品質、リソース使用量の組み合わせを見つけましょう。

© 2026 The Qt Company Ltd. Documentation contributions included herein are the copyrights of their respective owners. The documentation provided herein is licensed under the terms of the GNU Free Documentation License version 1.3 as published by the Free Software Foundation. Qt and respective logos are trademarks of The Qt Company Ltd. in Finland and/or other countries worldwide. All other trademarks are property of their respective owners.