人工智能翻译

AI 翻译功能可让您使用大型语言模型 (LLM) 为打开的 TS 文件自动生成翻译。您可以使用本地 LLM 服务器(如Ollama、LM Studio 或llama.cpp)或支持 OpenAI 兼容 REST 协议的云 API(如 OpenAI、Groq 或 Anthropic)。

Qt Linguist 支持两种 API 模式:

- Ollama- Ollama 的本地 REST API。在本地运行Ollama时使用。

- OpenAI 兼容- 标准 OpenAI REST API 格式。用于以下情况:

- 本地服务器:LM Studio、llama.cpp 或 Ollama(也支持 OpenAI 兼容模式)

- 云提供商:OpenAI、Groq、DeepSeek 等

设置本地 LLM 服务器

要通过本地服务器使用人工智能翻译,请安装以下软件之一并下载至少一个模型:

注: 本地运行 LLM 需要足够的内存,具体取决于模型大小和量化级别。有关具体要求,请参阅 LLM 服务器文档,例如LM Studio 系统要求。

对于 Ollama,使用命令行提取模型:

ollama pull qwen3:14b

ollama serve对于 LM Studio,通过应用程序的界面下载模型并启动本地服务器:

lms server start

对于 llama.cpp,您可以使用内置模型预设之一:

llama-server --fim-qwen-7b-default

或者下载 GGUF 模型文件并手动启动服务器:

llama-server -m model.gguf --port 8080

使用云 API

要使用基于云的翻译服务,请选择 "OpenAI 兼容"作为 API 类型,输入提供商的 API 端点 URL 并提供 API 密钥。

只输入基本 URL,不含/v1 路径后缀。例如,OpenRouter使用https://openrouter.ai/api 。有关正确的端点 URL,请查阅提供商的文档。

使用 AI 翻译对话框

在 Linguist 中,选择Tools > AI Translation 打开 AI 翻译对话框:

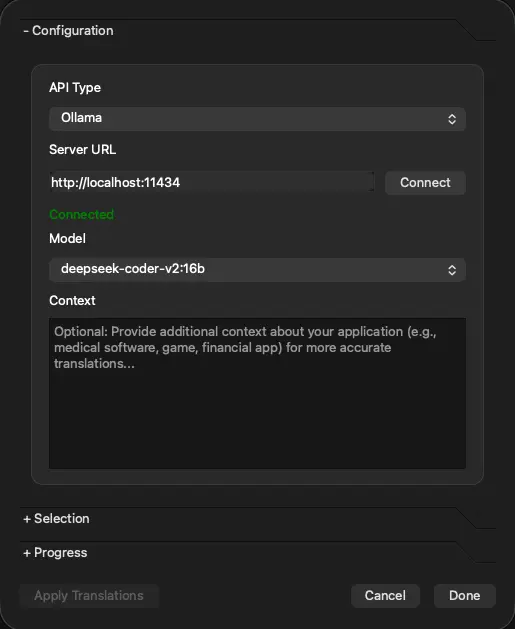

该对话框的Configuration 部分提供

- API Type选择 "Ollama":使用 Ollama 本机 API 的本地 Ollama 服务器,或选择 "OpenAI 兼容":LM Studio、llama.cpp、云 API 或 OpenAI 兼容模式下的 Ollama。

- Server URL:服务器监听的基本 URL。请勿包含

/v1路径后缀。默认值:Ollama 为http://localhost:11434,OpenAI 兼容模式为http://localhost:8080。 - API Key认证密钥:云 API 的认证密钥(本地服务器可选)。

- Model下拉列表:可用模型的下拉列表。

- Context应用上下文:可选应用上下文,以提高翻译准确性(如 "医疗软件"、"视频游戏"、"金融应用")。

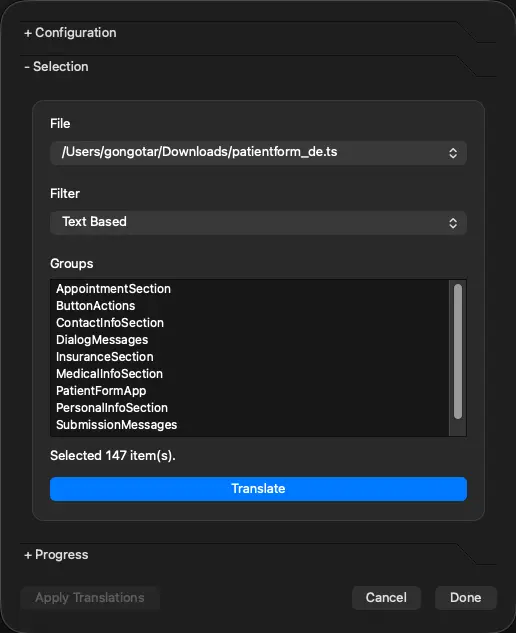

对话框的Selection 部分提供

- File要翻译的 TS 文件。

- Filter限制翻译到特定组(上下文或标签)。

- Translate开始人工智能翻译。

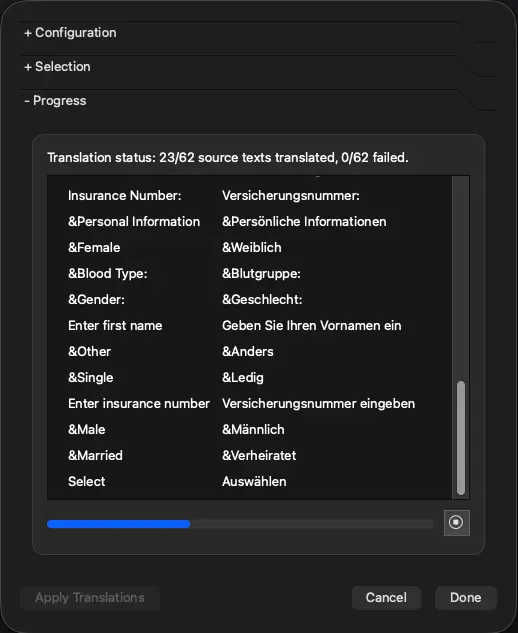

对话框的Progress 部分提供

- 停止按钮,用于停止翻译进度

- Apply Translations:将翻译好的项目应用到 TS 文件中。

在翻译过程中,进度信息会显示在Translation Log 中。翻译完成后,可查看日志中的翻译文本。单击Apply Translations ,将人工智能生成的翻译插入 TS 文件。

推荐模型

在平衡质量、速度和资源使用的前提下,推荐使用以下模型来完成翻译任务。这些模型可在以下网站找到:

| 模型 | 大小 | 说明 |

|---|---|---|

| 米斯特拉尔小型 24B | 14 GB | 翻译质量高,支持多种语言。需要 >16 GB VRAM 才能获得最佳性能。 |

| Qwen3 14B | 9 GB | 兼顾质量和资源使用。支持 100 多种语言。 |

| Qwen3 30B | 19 GB | 高质量翻译。使用 MoE 架构实现高效推理。 |

| Qwen2.5 14B | 9 GB | 强大的多语言支持,可支持 29 多种语言,包括中日韩语言。 |

| Gemma 3 12B | 8 GB | 支持 140 多种语言。适用于资源有限的系统。 |

| 7shi/llama-translate 8B | 5 GB | 英语、法语、中文和日语的专业翻译模型。适用于有限硬件的轻量级选项。仅适用于 Ollama。 |

对于资源有限的系统,Qwen3 8B (5 GB) 或 Qwen2.5 7B (5 GB) 等较小的变体可提供合理的翻译质量,但所需内存较少。

注: 翻译质量因语言对和模型而异。请测试不同的模型,以找到速度、质量和资源使用的最佳组合,满足您的特定翻译需求。

© 2026 The Qt Company Ltd. Documentation contributions included herein are the copyrights of their respective owners. The documentation provided herein is licensed under the terms of the GNU Free Documentation License version 1.3 as published by the Free Software Foundation. Qt and respective logos are trademarks of The Qt Company Ltd. in Finland and/or other countries worldwide. All other trademarks are property of their respective owners.